El último On-Prem Server (3.1) de Navicat está llevando la asistencia de IA a la administración de bases de datos a lo grande. De hecho, dos de sus tres nuevas características incluyen IA: hay un Asistente de IA de propósito general, así como una herramienta de “Preguntar a la IA” más especializada y orientada al desarrollo SQL. Ambas dependen de APIs de modelos de IA populares. En el artículo del blog de hoy, aprenderemos lo fácil que es dar los primeros pasos con los Asistentes de IA para que su equipo pueda beneficiarse del poder de la orientación de la IA.

Una breve introducción a las APIs de IA

Las APIs (Interfaces de Programación de Aplicaciones) de IA son servicios que permiten a los desarrolladores acceder a capacidades de IA a través de internet sin tener que compilar o alojar los modelos de IA subyacentes ellos mismos. En lugar de entrenar su propio modelo de lenguaje grande (LLM) - lo cual requiere enormes recursos informáticos y experiencia - simplemente envía una solicitud a una API de IA y recibe una respuesta inteligente de vuelta en segundos.

Los casos de uso de las APIs de IA son notablemente amplios, lo que es parte de por qué se han vuelto tan populares. Impulsan tareas de procesamiento de lenguaje natural como responder preguntas, resumir documentos, traducir idiomas y analizar sentimientos. En el desarrollo de software, habilitan características de asistencia de código que pueden generar, explicar, depurar y optimizar código - exactamente como hace la herramienta “Preguntar a la IA” de Navicat para SQL. Más allá del desarrollo, las APIs de IA se utilizan ampliamente para la generación de contenido, extracción de datos, chatbots, asistentes virtuales y reconocimiento de imágenes.

Es por esto que configurar el Asistente de IA en Navicat implica seleccionar y conectarse a un proveedor de API de IA, esencialmente dándole al software su "cerebro". ¡Así que, ahora, pasemos a eso!

Añadiendo un Asistente de IA

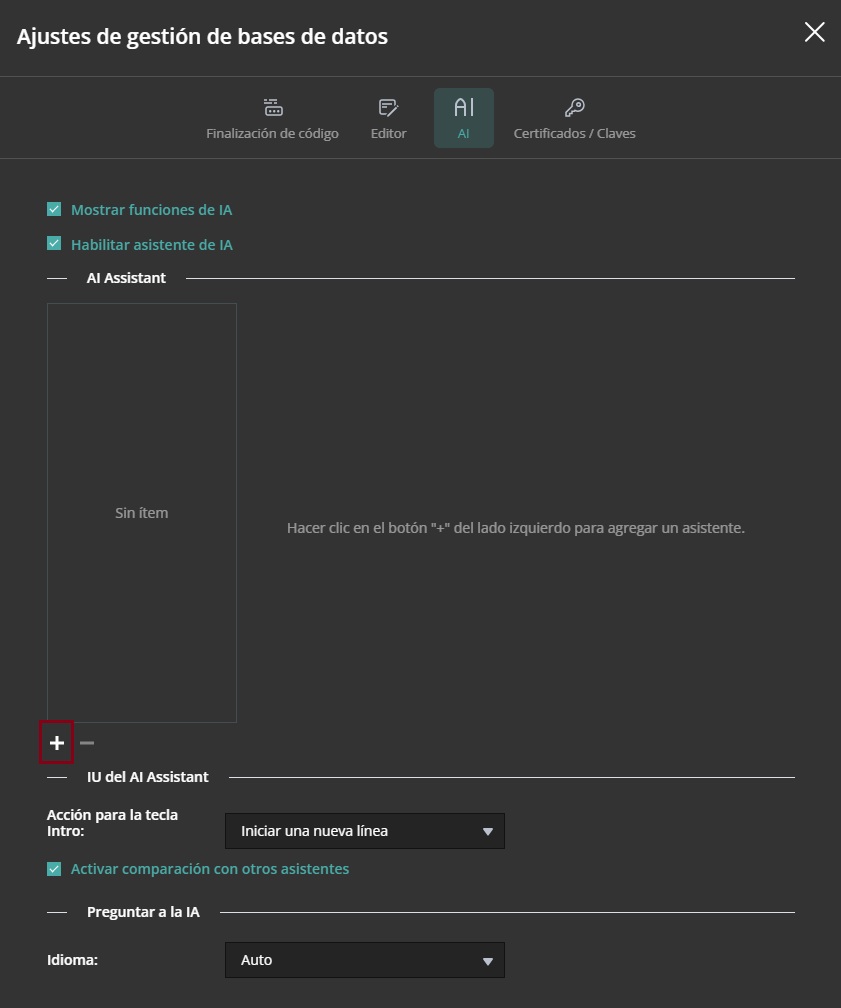

Todos los detalles correspondientes a los Asistentes de IA se encuentran en la pantalla de Configuración de Administración de Bases de Datos. Está disponible haciendo clic en el desplegable que está asociado a su nombre de perfil:

En la pantalla de Configuración de Administración de Bases de Datos, haga clic en el botón de IA en la parte superior del cuadro de diálogo para mostrar todos los detalles del Asistente de IA. Al principio estará casi vacío porque aún no hemos seleccionado un Modelo de IA. Para hacerlo, haga clic en el icono más (+) en la parte inferior de la lista del Asistente de IA:

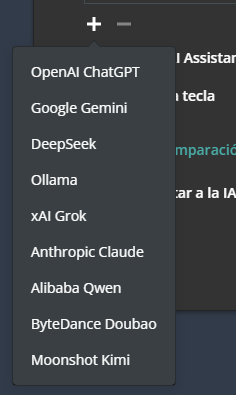

Al hacerlo se abrirá un menú que contiene todos los modelos de IA disponibles de los proveedores. Todos los proveedores más populares son compatibles, incluyendo Anthropic Claude, Google Gemini, DeepSeek, Grok y más.

Una vez que haya seleccionado un proveedor de modelos de IA, aparecerán varios campos a la derecha de la lista del Asistente de IA. Estos variarán dependiendo del proveedor que elija. Por ejemplo, Claude soporta un parámetro max_tokens que vemos en la pantalla como "Max Tokens". El número correcto para los Tokens Máximos depende de para qué esté utilizando Claude, pero aquí hay algunas directrices:

- Confirmaciones/clasificaciones simples: 256-512 tokens

- Chat&Preguntas y Respuestas: 1024-2048 tokens suele ser suficiente

- Generación de código: 4096-8192 tokens para funciones complejas

- Escritura/creación de contenido: 4096-8192 tokens

Cosas importantes a saber:

- max_tokens es el máximo que Claude puede generar - se detendrá cuando haya terminado, incluso si no ha alcanzado el límite

- 1 token ≈ 4 caracteres o aproximadamente 0,75 palabras en inglés, por lo que 1024 tokens ≈ 750-800 palabras

- El máximo varía según el modelo - los modelos de Claude admiten hasta 8192 tokens de salida (aunque la ventana de contexto total es mucho más grande)

- Solo se le cobra por los tokens realmente utilizados, no por el máximo que especifique

Si desea limitar la longitud de las respuestas, comience con 4096 tokens - esto le da a Claude mucho espacio para respuestas detalladas sin ser innecesariamente un índice alto. Si nota que las respuestas se cortan, auméntelo. Si sabe que solo necesita respuestas breves, puede reducirlo para ahorrar un poco en costes. Recuerde que establecerlo más alto no le cuesta más a menos que Claude realmente use esos tokens, por lo que a menudo es seguro ser generoso con este parámetro.

Obteniendo una clave API

Independientemente de qué proveedor de IA elija, la clave API es la pieza de información más crucial que necesitará proporcionar. Necesitará obtener una clave API de su proveedor de IA elegido. Una clave API es esencialmente una contraseña única autogenerada que identifica su aplicación y le otorga acceso al servicio de IA. Cuando Navicat On-Prem Server envía una solicitud a una API, incluye esta clave como parte de la solicitud, permitiendo al proveedor verificar su identidad, rastrear su uso y aplicar los cargos de facturación apropiados.

Las claves API se obtienen registrando una cuenta en la plataforma de su proveedor elegido — como la Consola de Anthropic en console.anthropic.com o la plataforma de OpenAI en platform.openai.com — y normalmente se generan al instante bajo demanda. Dado que una clave API proporciona acceso directo a un servicio de pago, debe tratarse como una contraseña: almacenada de forma segura, nunca compartida públicamente y nunca incrustada en código públicamente accesible. La mayoría de los proveedores le permiten generar múltiples claves para diferentes aplicaciones o miembros del equipo, y revocarlas al instante si alguna vez se ven comprometidas.

Eligiendo un modelo

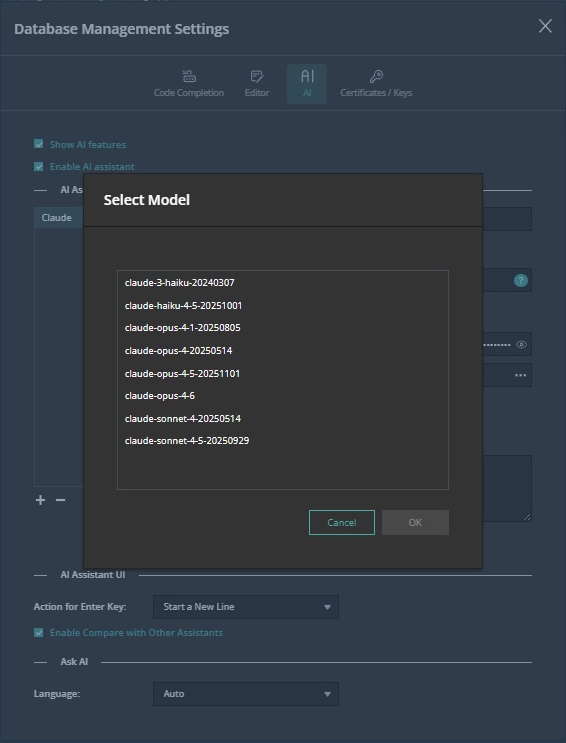

La decisión más importante que deberá tomar - junto a la del proveedor - es qué modelo usar. La mayoría de los proveedores de IA ofrecen varios para elegir .Al hacer clic en los puntos suspensivos (...) a la derecha del cuadro de texto del Modelo, se abre un cuadro de diálogo donde puede seleccionar un modelo. Aquí están las opciones para Claude:

Vale la pena señalar que el coste por usar diferentes modelos puede variar significativamente. Consulte la página de descripción general de los modelos del proveedor para obtener la información exacta de precios. Por ejemplo, aquí está la página de descripción general de Claude.

Poniéndolo todo junto

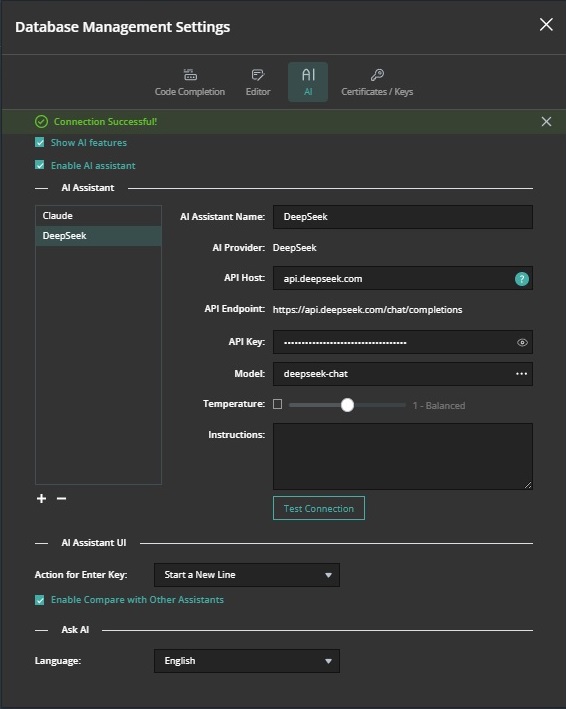

Una vez que haya completado la información necesaria, puede probar el servicio de la API haciendo clic en el botón "Test Connection" (Probar Conexión). Si todo va bien, debería ver un mensaje de "¡Conexión Exitosa!" en la parte superior de la pantalla:

¡Ahora está listo para usar tanto las herramientas de On-Prem Server 3.1 Asistente de IA como Preguntar a la IA!